20. Dezember 2017

Forscher vereinheitlichen Theorien der neuronalen Informationskodierung

Wissenschaftler am IST Austria und in Paris kombinieren und erweitern bisherige Theorien darüber, wie Neuronen in unseren sensorischen Systemen Informationen selektieren und übertragen| Neue Theorie gibt konkrete Vorhersagen für bisher nicht untersuchte Kodierungssysteme

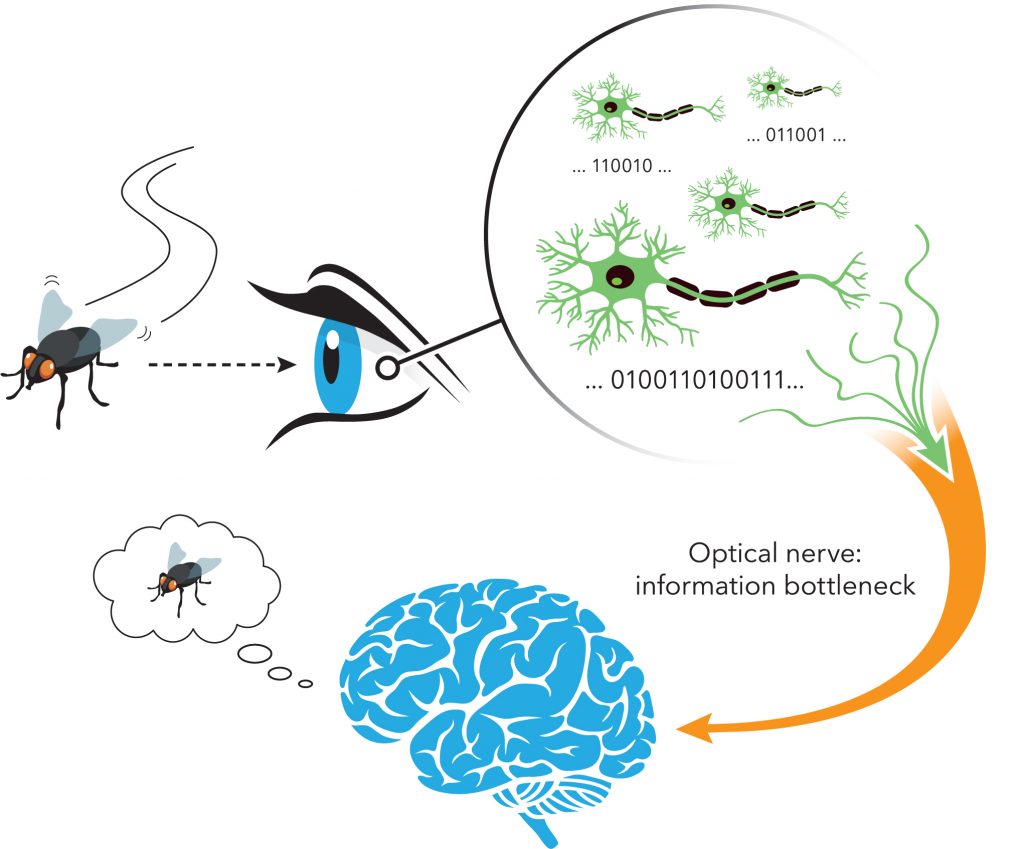

Digitale Videokameras können unglaublich detailliert aufzeichnen, aber das Speichern all dieser Daten würde sehr viel Platz beanspruchen. Den Ingenieuren stellt sich daher die Frage, wie man ein Video komprimieren, also Informationen entfernen kann, so dass man beim Abspielen den Unterschied nicht bemerkt. Mit einem ähnlichen Problem sind auch unsere Augen konfrontiert: sie werden mit visuellen Informationen überflutet, aber die Möglichkeiten der Neuronen in unseren Augen sind begrenzt. Wie also wählen Neuronen aus dieser Menge an Reizen aus, welche Information extrahiert und an das Gehirn gesendet wird? Neurowissenschaftler stellen sich diese Frage seit Jahrzehnten und haben verschiedene Theorien entwickelt, um vorherzusagen, was Neuronen in bestimmten Situationen tun werden. Jetzt haben Matthew Chalk (ehemals Postdoc am IST Austria und derzeit am Vision Institute in Paris), IST Austria-Professor Gašper Tkačik sowie Olivier Marre, der ein Netzhautforschungslabor am Vision Institute leitet, ein Rahmenwerk entwickelt, das die vorherigen Theorien als Sonderfälle verbindet. Es ermöglicht den Forschern auch, Vorhersagen über jene Arten von Neuronen zu machen, die bisher von keiner Theorie beschrieben wurden.

Eines der Hauptziele der sensorischen Neurowissenschaften besteht darin, neuronale Reaktionen durch mathematische Modelle vorherzusagen. Diese Vorhersagen basierten bisher auf drei Haupttheorien, von denen jede ein anderes Anwendungsgebiet hatte. Jedes entsprach unterschiedlichen Annahmen über die internen Beschränkungen der Neuronen, die Art des Signals und den Zweck der gesammelten Information. Ein neuronaler Code ist im Wesentlichen eine Funktion die voraussagt, wann ein Neuron „feuern“ wird. Das Aktionspotential-Signal entspricht dabei einer digitalen „1“ im Binärsystem. Sammlungen von einem oder mehreren Neuronen, die zu bestimmten Zeiten feuern, können somit Informationen codieren. Eine effiziente Kodierung setzt voraus, dass die Neuronen unter Berücksichtigung ihrer internen Beschränkungen wie zum Beispiel Rauschen oder Metabolismus, so viel Information wie möglich kodieren. Vorhersagende Kodierung dagegen setzt voraus, dass nur jene Information kodiert wird, die für die Vorhersage der Zukunft relevant ist, zum Beispiel in welche Richtung ein Insekt fliegen wird. Schlussendlich nimmt „sparse coding“ (die spärliche Kodierung) an, dass nur einige Neuronen gleichzeitig aktiv sind. Allerdings war unklar, inwieweit diese Theorien verwandt waren und ob sie vielleicht sogar miteinander übereinstimmten. Diese neuesten Entwicklungen bringen nun Ordnung in die theoretische Landschaft: „Bisher wusste man nicht, wie man diese Theorien verbinden oder vergleichen kann. Unser Rahmenwerk überwindet das indem es sie innerhalb einer übergreifenden Struktur zusammenfügt“, erklärt Gašper Tkačik.

Im Kontext dieses Rahmenwerks kann ein neuronaler Code als der Code interpretiert werden, der eine bestimmte mathematische Funktion maximiert. Diese Funktion – und der neuronale Code, der sie maximiert – hängt von drei Parametern ab: vom Rauschen im Signal, vom Ziel beziehungsweise der Aufgabe, zum Beispiel ob das Signal zur Vorhersage der Zukunft verwendet wird, und von der Komplexität des zu codierenden Signals. Die oben beschriebenen Theorien gelten nur für bestimmte Wertebereiche dieser Parameter und decken nicht den gesamten möglichen Parameterraum ab. Das führt zu Problemen beim Versuch, sie experimentell zu testen. Gašper Tkačik erklärt: „Wenn Sie Stimuli entwerfen, die sie dann den Neuronen präsentieren um das Modell zu testen, ist es extrem schwierig zu unterscheiden, ob ein Neuron nicht vollständig mit Ihrer Lieblingstheorie übereinstimmt oder ob Ihre Lieblingstheorie einfach unvollständig ist. Unser einheitlicher Rahmen kann nun konkrete Vorhersagen für Parameterwerte geben, die zwischen denen der zuvor untersuchten Fälle liegen.“

Die vereinheitlichte Theorie des Teams überwindet frühere Einschränkungen, indem sie den Neuronen erlaubt, „gemischte“ Kodierungsziele zu haben. Sie müssen also nicht in eine klare, zuvor untersuchte Kategorie fallen. Zum Beispiel kann die neue Theorie den Fall abdecken, in dem Neuronen einzeln ein sehr hohen Rauschen haben, aber dennoch spärliche Stimuli effizient codieren sollten. Allgemeiner ausgedrückt können optimale neuronale Codes auf einem Kontinuum entsprechend den Parameterwerten platziert werden, die Optimalitätsbeschränkungen definieren. Das erklärt Phänomene, die zuvor beobachtet wurden, aber durch keines der existierenden Modelle erklärt werden konnten. Für den Erstautor Matthew Chalk ist dies einer der spannendsten Beiträge ihrer Arbeit: „Viele der Theorien, die Vorhersagen erlauben, sind im Test unflexibel: Entweder haben sie das richtige Ergebnis vorhergesagt oder nicht. Wovon wir mehr brauchen und was unsere Studie bietet, sind Rahmenwerke die in der Lage sind, Hypothesen für eine Vielzahl von Situationen und Annahmen zu erzeugen.“

Abgesehen davon, dass es die Theorie mit größerer Flexibilität ausstattet, macht das Rahmenwerk der Forscher konkrete Vorhersagen für Arten von neuronaler Kodierung, die bisher unerforscht waren, zum Beispiel für Kodierung, die sowohl spärlich als auch vorhersagend ist. Als Nachfolgeprojekt zu ihrer neuen Theorie, entwirft Matthew Chalk Experimente, um diese Vorhersagen zu überprüfen und um Neuronen als effizient, vorhersagend, spärlich oder als eine Kombination dieser Kodierungsziele zu kategorisieren. In Olivier Marres Labor am Institut de la Vision in Paris konzentriert er sich auf die Netzhaut und entwickelt visuelle Stimuli, die die Netzhautneuronen aktivieren, um ihre Kodierungsziele am besten zu enthüllen.

Zudem kann das Rahmenwerk auch breiter angewendet werden: „Man muss nicht unbedingt nur an Neuronen denken“, fügt Gašper Tkačik hinzu. „Die Idee, dieses Problem unter dem Gesichtspunkt der Optimierung zu betrachten, kann bei jeder Art von Systemen verwendet werden, die Signale verarbeiten. Und die Approximation erlaubt uns, auch solche Systeme zu studieren deren Funktionen normalerweise mit Berechnungen schwer zu bewältigen sind.“ Den Grundstein für diese weiteren Anwendungen legten die drei Wissenschaftler bereits in einem früherer Artikel, der in Advances in Neural Information Processing Systems (NIPS) publiziert wurde.

Quellen

- Matthew Chalk, Olivier Marre, und Gašper Tkačik: “Towards a unified theory of efficient, predictive and sparse coding”, PNAS 2017

- Frühere Studien in NIPS: Matthew Chalk, Olivier Marre, and Gašper Tkačik: “Relevant sparse codes with variational information bottleneck”, NIPS 2016

- https://papers.nips.cc/paper/6101-relevant-sparse-codes-with-variational-information-bottleneck